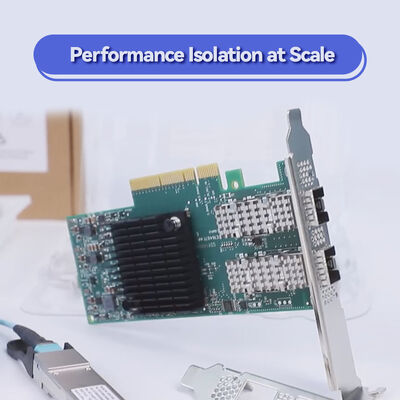

NVIDIA ConnectX-6 MCX653106A-HDAT 200Gb/s 듀얼 포트 인피니밴드 스마트 어댑터

제품 상세 정보:

| 브랜드 이름: | Mellanox |

| 모델 번호: | MCX653106A-HDAT |

| 문서: | connectx-6-infiniband.pdf |

결제 및 배송 조건:

| 최소 주문 수량: | 1개 |

|---|---|

| 가격: | Negotiate |

| 포장 세부 사항: | 외부 상자 |

| 배달 시간: | 목록을 기반으로 |

| 지불 조건: | 티/티 |

| 공급 능력: | 프로젝트/배치 별 공급 |

|

상세 정보 |

|||

| 제품상태: | 재고 | 애플리케이션: | 섬기는 사람 |

|---|---|---|---|

| 상태: | 신규 및 원본 | 유형: | 열광한 |

| 최대 속도: | 최대 200GB/s | 이더넷 커넥터: | QSFP56 |

| 모델: | MCX653106A-HDAT | ||

제품 설명

MCX653106A-HDAT – 듀얼 포트 200Gb/s

까다로운 HPC, AI 및 하이퍼스케일 클라우드 인프라를 위해 설계된 NVIDIA® ConnectX®-6 MCX653106A-HDAT 스마트 어댑터 카드는 최대 200Gb/s의 대역폭을 포트당 제공하며 네트워크 내 컴퓨팅 가속 기능을 갖추고 있습니다. CPU에서 연산을 오프로드하여 딥 신경망 학습부터 실시간 데이터 분석까지 효율성, 확장성 및 보안을 획기적으로 향상시킵니다.

NVIDIA Quantum InfiniBand 플랫폼의 핵심 구성 요소인 ConnectX-6는 엔드투엔드 RDMA, 하드웨어 기반 안정적인 전송 및 고급 혼잡 제어를 지원합니다. PCIe 3.0/4.0 x16 모델은 듀얼 포트 QSFP56을 특징으로 하며 InfiniBand 및 이더넷(최대 200Gb/s)을 모두 지원합니다. 블록 수준 XTS-AES 암호화, NVMe over Fabrics(NVMe-oF) 오프로드 및 GPUDirect RDMA 가속 기능을 통합하여 GPU 가속 클러스터, 소프트웨어 정의 스토리지 및 가상화된 네트워크에 이상적인 선택입니다.

NVIDIA ConnectX-6는 기존 한계를 넘어선 원격 직접 메모리 액세스(RDMA)를 제공합니다. MPI 태그 일치, 적응형 라우팅을 지원하는 순서 없는 RDMA 및 동적 연결 전송(DCT)을 위한 하드웨어 오프로드를 구현하여 수천 개의 노드에 걸쳐 효율적인 확장을 보장합니다. 어댑터의 네트워크 내 메모리 기능은 등록 불필요 RDMA 메모리 액세스를 가능하게 하여 소프트웨어 오버헤드를 줄입니다. PCIe Gen 4.0과 결합하여 데이터는 메모리와 네트워크 간에 직접 이동하여 CPU 사이클을 애플리케이션 로직에 할당합니다.

RoCE(RDMA over Converged Ethernet) 및 오버레이 네트워크 터널링 오프로드를 지원하는 ConnectX-6는 InfiniBand 및 이더넷 환경 모두에 대한 통합 스마트 패브릭을 제공합니다.일반적인 배포고성능 컴퓨팅(HPC):

- AI 및 머신러닝: GPUDirect RDMA 및 고처리량 200Gb/s 링크를 사용하여 딥 신경망의 분산 학습을 가속화합니다.

- NVMe-oF 스토리지 어레이: 하드웨어 오프로드를 사용하여 고성능 NVMe/TCP 또는 NVMe/RDMA 스토리지 타겟을 구축하여 CPU 부하를 줄입니다.

- 하이퍼스케일 클라우드 및 NFV: 효율적인 서비스 체이닝, OVS 오프로드(ASAP²), 어댑터당 최대 1K개의 가상 함수를 위한 SR-IOV.

- 빅 데이터 분석: 스트리밍 엔진 및 분산 데이터베이스를 위한 네트워크 내 컴퓨팅 가속.

- 호환성ConnectX-6 MCX653106A-HDAT는 광범위한 서버, 스위치 및 OS 환경과 호환됩니다. 자동 협상을 통해 최대 200Gb/s(HDR)의

및 최대 200Gb/s의 이더넷 스위치를 지원합니다. 이 어댑터는 x86, Power, Arm, GPU 및 FPGA 기반 플랫폼에서 작동합니다.카테고리지원 옵션 / 표준

| 운영 체제 | RHEL, SLES, Ubuntu, 기타 주요 Linux 배포판, Windows Server, FreeBSD, VMware vSphere |

|---|---|

| InfiniBand 사양 | IBTA 1.3 준수, 200/100/50/25/10Gb/s, 8개의 가상 레인 + VL15 |

| 이더넷 표준 | 200/100/50/40/25/10/1GbE, IEEE 802.3bj, 802.3by, PFC, ETS, DCB, 1588v2 |

| CPU 오프로드 및 가상화 | SR-IOV(1K VF), NPAR, DPDK, ASAP² OVS 오프로드, 터널링(VXLAN, NVGRE, Geneve) |

| 관리 및 부팅 | NC-SI, SMBus/PCIe를 통한 MCTP, PLDM(DSP0248/DSP0267), UEFI, PXE, iSCSI 원격 부팅 |

| 기술 사양 | 매개변수 |

| 제품 모델 | MCX653106A-HDAT |

|---|---|

| 폼 팩터 | PCIe 3.0/4.0 x16 |

| 네트워크 포트 | 2x QSFP56(듀얼 포트) |

| 지원 속도 | InfiniBand: 200/100/50/25/10 Gb/s; 이더넷: 200/100/50/40/25/10/1 Gb/s |

| 호스트 인터페이스 | PCIe Gen 3.0/4.0 x16(x8, x4, x2, x1도 지원) |

| MCX653106A-HDAT | 포트당 200Gb/s |

| 메시지 속도 | 초당 최대 2억 1,500만 개 |

| 지연 시간 | 극히 낮음(마이크로초 미만 RDMA) |

| 하드웨어 암호화 | XTS-AES 256/512비트 블록 수준 암호화, FIPS 지원 가능 |

| 스토리지 오프로드 | NVMe-oF 타겟/이니시에이터, T10-DIF, SRP, iSER, NFS RDMA, SMB Direct |

| 가상화 | SR-IOV(최대 1K VF), VMware NetQueue, VM당 QoS |

| 원격 부팅 | InfiniBand, 이더넷, iSCSI, UEFI, PXE |

| 치수(브래킷 제외) | 167.65mm x 68.90mm |

| RoHS 및 규정 준수 | RoHS 준수, ODCC 호환 |

| 선택 가이드 – ConnectX-6 제품군 | 주문 부품 번호(OPN) |

| 호스트 인터페이스 | 주요 기능 | MCX653106A-HDAT | 2x QSFP56, 최대 200Gb/s |

|---|---|---|---|

| PCIe 3.0/4.0 x16 | 듀얼 포트, 암호화, 표준 브래킷 | MCX653436A-HDAT (OCP 3.0) | 1x QSFP56, 200Gb/s |

| PCIe 3.0/4.0 x16 | 단일 포트, 암호화 지원 | MCX653436A-HDAT (OCP 3.0) | 2x QSFP56, 100Gb/s |

| PCIe 3.0/4.0 x16 | 100Gb/s 변형, 암호화 없음 | MCX653436A-HDAT (OCP 3.0) | 2x QSFP56, 200Gb/s |

| PCIe x16 | OCP 3.0 소형 폼 팩터 | MCX654106A-HCAT | 2x QSFP56, 소켓 직접 |

| 2x PCIe 3.0 x16 | 전용 CPU 액세스, 소켓 직접 | 참고: 액체 냉각 Intel 서버 시스템 D50TNP용 콜드 플레이트가 있는 변형의 경우 맞춤형 주문에 대해 Starsurge에 문의하십시오. | ConnectX-6에 Starsurge를 선택해야 하는 이유 |

✔ 정품 및 인증 재고

미주, EMEA, APAC 지역에 서비스를 제공하는 창고 및 파트너 허브.

펌웨어 구성, RDMA 튜닝, NVMe-oF 검증.

NVIDIA 파트너와의 장기적인 관계, 비용 효율적.

번거로움 없는 교체 및 고급 크로스 배송 가능.

영어, 중국어 및 맞춤형 통합 지원.

홍콩 Starsurge Group은 호환성 확인, 펌웨어 사용자 정의, 현장 배포 안내에 이르기까지 엔드투엔드 지원을 제공합니다. 데이터 센터 업그레이드 및 개념 증명(PoC) 테스트를 위한 전담 기술 계정 관리자를 제공합니다. 모든 어댑터는 정전기 방지 포장 및 선택적 설치 키트와 함께 배송됩니다.

자주 묻는 질문

MCX653106A-HDAT와 표준 ConnectX-6 카드 간의 차이점은 무엇입니까?

예, NVIDIA GPUDirect RDMA(PeerDirect)를 완벽하게 지원하여 직접적인 GPU-네트워크 통신을 가능하게 하고 불필요한 메모리 복사를 제거하며 AI 학습의 지연 시간을 줄입니다.

물론입니다. PCIe Gen 3.0, Gen 2.0 및 Gen 1.1과 하위 호환되지만 최대 처리량은 Gen 4.0 호스트에 비해 제한될 수 있습니다.

ESD 보호 기능이 있는 패시브 구리 케이블, 액티브 광 케이블 및 전원 커넥터. InfiniBand의 경우 HDR 호환 브레이크아웃이 지원됩니다.

예, ConnectX-6는 타겟 및 이니시에이터 모두에 대한 NVMe over Fabrics 오프로드를 제공하여 CPU 오버헤드를 크게 줄이고 IOPS 확장성을 향상시킵니다.

서버 기계적 간섭 확인: 표준 높이 PCIe 브래킷 포함; 로우 프로파일 브래킷도 액세서리로 제공됩니다.

- Linux 배포판 버전과의 드라이버 호환성을 확인하십시오 – NVIDIA OFED를 권장합니다.

- 공개적으로 명시되지 않음: 최대 200Gb/s 부하에서 포트당 정확한 전력 소비량 – NVIDIA 사용자 설명서를 참조하거나 일반적인 값(총 약 15-18W)에 대해 Starsurge에 문의하십시오.

- FIPS 인증은 하드웨어적으로 가능하지만 특정 펌웨어가 필요할 수 있습니다 – FIPS 규정 준수가 필수인 경우 영업팀에 알리십시오.

- 홍콩 Starsurge Group 소개

- 2008년에 설립된

는 네트워크 하드웨어, IT 서비스 및 시스템 통합 솔루션을 제공하는 기술 중심 기업입니다. 정부, 의료, 제조, 교육, 금융 및 기업 부문에 걸친 글로벌 고객 기반을 통해 Starsurge는 스위치, NIC, 무선 솔루션 및 맞춤형 소프트웨어를 포함한 고성능 네트워킹 장비를 제공합니다. 이 회사는 숙련된 영업 및 기술 팀을 결합하여 복잡한 인프라 프로젝트, IoT 배포 및 네트워크 관리 시스템을 지원합니다. 고객 우선 접근 방식, 신뢰할 수 있는 품질 및 신속한 글로벌 배송은 Starsurge를 차세대 데이터 센터의 신뢰할 수 있는 파트너로 만듭니다.Starsurge 팀에 문의하기 ➔주요 사실 – NVIDIA ConnectX-6 MCX653106A-HDAT

| 최대 처리량 | 포트당 200Gb/s(총 400Gb/s 이론상) |

|---|---|

| 온칩 가속 | 태그 일치, 랑데부 오프로드, 집계 오프로드, 버스트 버퍼 |

| 가상 함수 | 어댑터당 최대 1024개 VF |

| 암호화 표준 | XTS-AES 256/512비트, CPU에서 오프로드됨 |

| 적응형 라우팅 | 순서 없는 RDMA 지원 |

| 호환성 매트릭스(사전 검증된 플랫폼) | 서버 / 플랫폼 |

| 테스트된 OS | Dell PowerEdge R750 | Intel Xeon Scalable (4세대) |

|---|---|---|

| RHEL 8.6, Ubuntu 22.04 | HPE ProLiant DL380 Gen10 Plus | Intel Xeon |

| SLES 15 SP4, VMware ESXi 7.0 | NVIDIA DGX / HGX 기본 | AMD EPYC 7003 |

| Ubuntu 20.04, NVIDIA HPC SDK | Lenovo ThinkSystem SR650 | Intel Xeon |

| Windows Server 2022 | NVIDIA DGX / HGX 기본 | NVIDIA Arm / x86 |

| Ubuntu with MLNX_OFED | 구매자 체크리스트 – ConnectX-6 주문 전 | ☐ PCIe 슬롯 유형: x16 기계(전기 x16/x8/x4 지원) |

- ☐ OS 드라이버 가용성: MLNX_OFED 또는 WinOF-2 버전 확인

- ☐ 암호화 요구 사항: FIPS 모드 또는 표준 AES-XTS

- ☐ 냉각 및 브래킷: 표준 또는 콜드 플레이트 옵션 필요?

- ☐ 수량 및 리드 타임: Starsurge 영업팀과 재고 확인

- 관련 제품(NVIDIA 생태계)

- NVIDIA Quantum InfiniBand 스위치

이더넷 및 RoCE에 최적화, 200Gb/s

프로그래밍 가능한 데이터 경로를 갖춘 InfiniBand/이더넷

200G용 DAC, AOC 및 액티브 광 케이블

▶ NVIDIA ConnectX-6 사용자 설명서(펌웨어 및 구성)

- ▶ ConnectX-6를 사용한 NVMe-oF: 모범 사례

- ▶ MPI 및 GPUDirect 성능 튜닝

- ▶ FIPS 환경을 위한 블록 수준 암호화 설정

- * 사양 및 기능은 게시된 NVIDIA 데이터시트를 기반으로 하며 업데이트될 수 있습니다. 정확한 기술 세부 정보는 공식 NVIDIA 설명서를 참조하거나 Starsurge 사전 판매 엔지니어링에 문의하십시오.