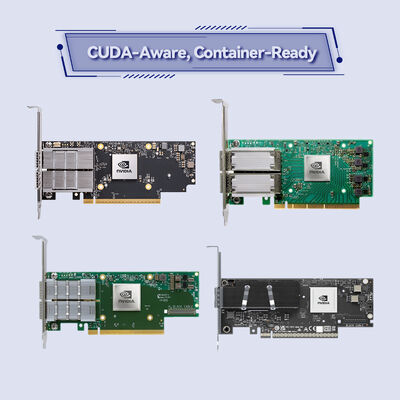

NVIDIA MCX555A-ECAT 100Gb/s 싱글 포트 QSFP28 인피니밴드 어댑터 PCIe 3.0 x16 커넥트X-5 네트워크 카드

제품 상세 정보:

| 브랜드 이름: | Mellanox |

| 모델 번호: | MCX555A-ECAT |

| 문서: | CONNECTX-5 infiniband.pdf |

결제 및 배송 조건:

| 최소 주문 수량: | 1개 |

|---|---|

| 가격: | Negotiate |

| 포장 세부 사항: | 외부 상자 |

| 배달 시간: | 목록을 기반으로 |

| 지불 조건: | 티/티 |

| 공급 능력: | 프로젝트/배치 별 공급 |

|

상세 정보 |

|||

| 제품상태: | 재고 | 애플리케이션: | 섬기는 사람 |

|---|---|---|---|

| 상태: | 신규 및 원본 | 유형: | 열광한 |

| 최대 속도: | EDR 및 100GBE | 이더넷 커넥터: | QSFP28 |

| 강조하다: | NVIDIA ConnectX-5 인피니밴드 어댑터,100Gb/s QSFP28 네트워크 카드,PCIe 3.0 x16 Mellanox 카드 |

||

제품 설명

HPC, AI 및 클라우드 데이터 센터를 위해 설계된 고성능, 낮은 지연 100Gb/s 네트워크 어댑터. NVMe over Fabrics, GPUDirect RDMA,그리고 MPI 워크로드에 대한 태그 매칭 업계에서 선도적인 처리량과 CPU 효율성을 제공합니다.

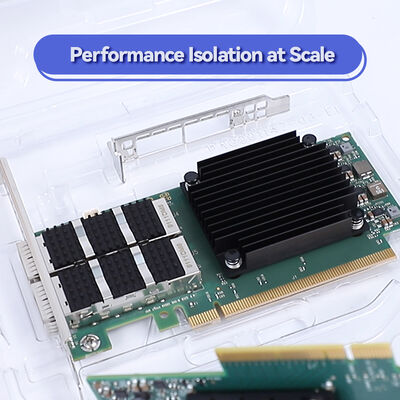

의NVIDIA ConnectX-5 MCX555A-ECAT그것은 낮은 프로필 PCIe 형식 인 단 포트 100Gb / s 인피니밴드 어댑터 카드입니다. 입증 된 ConnectX-5 아키텍처를 활용하여 최대100Gb/s 처리량미세초 이하의 지연 속도와 높은 메시지 속도. 이 카드는 InfiniBand (EDR까지) 와 100GbE를 모두 지원하며 고성능 컴퓨팅, 스토리지,그리고 가상화된 환경.

임베디드 PCIe 스위치와 고급 RDMA 기능을 탑재한 MCX555A-ECAT는 CPU에서 중요한 통신 작업을 해제하여 더 높은 애플리케이션 성능을 제공합니다.낮은 전력 소비, 및 소유의 총 비용을 줄입니다. PCIe 3.0 x16 슬롯과 완전히 호환되며 광범위한 운영 체제와 가속 프레임워크를 지원합니다.

- 최대 100Gb/s포트별 연결성 (InfiniBand EDR / 100GbE)

- 단일 QSFP28 커넥터광선 또는 구리 케이블용

- PCIe 3.0 x16 호스트 인터페이스(x8, x4, x2, x1으로 자동 협상)

- RDMA, 송수신 의미하드웨어 기반의 안정적인 운송

- 태그 일치 및 랜덤 로딩MPI와 SHMEM의 경우

- NVMe over Fabrics (NVMe-oF) 목표 출하효율적인 저장을 위해

- GPUDirect RDMA (PeerDirect)GPU 통신에 대한 가속

- 하드웨어 기반 혼잡 제어 및 적응 라우팅 지원

- SR-IOV 가상화:최대 512개의 가상 함수

- RoHS를 준수하고 낮은 프로파일 형태의 요소(높이 괄호 포함)

ConnectX-5 아키텍처는 CPU 개입을 줄이고 애플리케이션 확장성을 향상시키는 다양한 하드웨어 가속 엔진을 통합합니다.

- MPI 태그 매칭 & 랜데즈우 오프로드:메시지 매칭과 랜데즈브 프로토콜 처리를 오프로드하여 HPC 클러스터의 MPI 성능을 크게 향상시킵니다.

- 어댑티브 라우팅으로 오버 오더 RDMA여러 네트워크 경로를 효율적으로 사용할 수 있으며 질서 완료 시맨틱을 유지하여 직물 활용도를 극대화합니다.

- NVMe-oF 목표물 출하:NVMe 스토리지 시스템이 거의 제로 CPU 오버헤드로 원격 액세스를 제공하도록 허용합니다. 분산된 스토리지 아키텍처에 이상적입니다.

- 동적으로 연결된 운송 (DCT):연결 설정 오버헤드를 제거함으로써 큰 컴퓨팅 및 스토리지 시스템에 대한 극심한 확장성을 제공합니다.

- ASAP2 가속 전환 및 패킷 처리:오픈 vSwitch (OVS) 및 오버레이 네트워크 터널링 (VXLAN, NVGRE, GENEVE) 에 대한 하드웨어 오프로드

- 주문형 페이징 (ODP):RDMA 작업을 위한 가상 메모리 페이징을 지원하여 응용 프로그램 개발을 단순화합니다.

- 고성능 컴퓨팅 (HPC):슈퍼컴퓨팅 클러스터, MPI 기반 시뮬레이션 및 낮은 지연 속도와 높은 메시지 속도를 요구하는 과학 연구 작업에 이상적입니다.

- 인공지능과 딥러닝 교육:GPUDirect RDMA와 결합하여 노드 간 빠른 GPU-to-GPU 통신을 가능하게하여 훈련 시간을 가속화합니다.

- NVMe-oF 저장 시스템:높은 처리량, 낮은 지연 시간 블록 스토리지 액세스를 위해 NVMe over Fabrics 환경에서 스토리지 타겟 또는 이니셔터로 배포합니다.

- 클라우드 및 가상화된 데이터 센터:SR-IOV 및 가상화 오프로드는 보장된 QoS 및 안전한 격리와 함께 멀티-테넌트 환경을 지원합니다.

- 고주파 거래 (HFT):초저지연과 하드웨어 타임 스탬핑 (IEEE 1588v2) 은 금융 서비스 애플리케이션의 요구를 충족시킵니다.

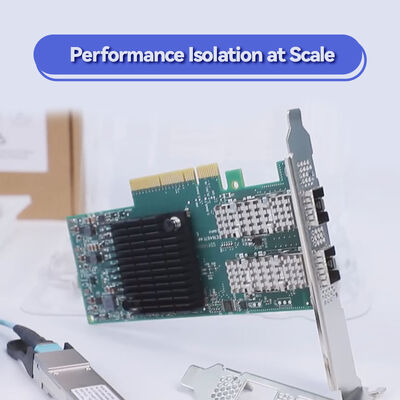

MCX555A-ECAT는 NVIDIA InfiniBand 스위치 (예를 들어, 퀀텀, 스펙트럼) 및 타사 100GbE 스위치와 광범위한 호환성을 위해 설계되었습니다.QSFP28 포트를 통해 수동 구리 DAC와 활성 광 케이블을 지원합니다..

운영 체제 및 소프트웨어 스택:

- RHEL / CentOS, 우분투, 윈도우 서버, FreeBSD, VMware ESXi

- 오픈 팩브릭스 엔터프라이즈 배포 (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, 인텔 MPI, 플랫폼 MPI

- 커널 우회용 데이터 플랜 개발 키트 (DPDK)

| 매개 변수 | 사양 |

|---|---|

| 모델 | MCX555A-ECAT |

| 형태 요인 | PCIe 낮은 프로필 (14.2cm x 6.9cm 브래킷 없이), 높은 브래킷 미리 설치, 짧은 브래킷 포함 |

| 포트 속도와 유형 | 1x QSFP28, 최대 100Gb/s 인피니밴드 (EDR) 및 100GbE |

| 호스트 인터페이스 | PCI Express 3.0 x16 (x8, x4, x2, x1과 호환) |

| 인피니밴드 지원 | IBTA 1.3 호환, 100Gb/s EDR, FDR, QDR, DDR, SDR; 8개의 가상 경로 + VL15; 1600만 개의 I/O 채널 |

| 이더넷 지원 | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| RDMA 능력 | 컨버지드 이더넷 (RoCE) 상의 RDMA, 하드웨어 신뢰성 있는 전송, 오버 오더 RDMA, 원자 작업 |

| 저장물 출하 | NVMe over Fabrics 목표 오프로드, iSER, SRP, NFS RDMA, SMB Direct, T10 DIF 서명 전달 |

| 가상화 | SR-IOV (최다 512개의 가상 기능), VMware NetQueue, NPAR, PCIe 액세스 제어 서비스 (ACS) |

| CPU 오프로드 | TCP/UDP/IP 상태 없는 오프로드, LSO/LRO, 체크섬 오프로드, RSS/TSS, VLAN/MPLS 태그 삽입/탈출 |

| 오버레이 네트워크 | VXLAN, NVGRE, GENEVE 캡슐화/디캡슐화용 하드웨어 출하 |

| 관리 | NC-SI over MCTP, 모니터/제어 및 펌웨어 업데이트를 위한 PLDM, I2C, SPI, JTAG |

| 원격 부팅 | 인피니밴드, 이더넷, iSCSI를 통해 원격 부팅; UEFI, PXE 지원 |

| 전력 소비 | 공개적으로 지정되지 않았습니다. 20W 이하의 전형적인 범위입니다. |

| 작동 온도 | 0°C ~ 55°C (유례적인 환경) |

| 준수 | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

참고: NVIDIA ConnectX-5 제품 문서에서 파생된 사양. 최신 세부 사항 및 펌웨어 지원은 공식 NVIDIA 릴리스 메모를 참조하십시오.

| 주문부품 번호 | 포트 / 속도 | 호스트 인터페이스 | 형태 요인 | 주요 특징 |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | 낮은 프로파일 PCIe | 표준 단일 포트, EDR 인피니밴드 / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100Gb/s | PCIe 3.0 x16 | 낮은 프로파일 PCIe | 듀얼 포트, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100Gb/s | PCIe 4.0 x16 | 낮은 프로파일 PCIe | 커넥트X-5 엑스, 향상된 PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100Gb/s | 2x PCIe 3.0 x8 | 소켓 다이렉트 | 배선을 통해 듀얼 소켓 서버 연결 |

| MCX545B-ECAN | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | OCP 2.0 타입 1 | 오픈 컴퓨트 프로젝트 형식 요소 |

OCP 또는 멀티 호스트 변종에 대해서는 판매에 문의하십시오. 모든 카드는 낮은 속도까지 후향 호환성을 지원합니다.

- 우수한 응용 성능:MPI, NVMe-oF를 위한 하드웨어 오프로드 및 비즈니스 로직을 위한 무료 CPU 코어 오버레이.

- 확장 가능한 RDMA 직물:DCT, XRC, 오트 오프 오더 RDMA는 수천 개의 노드에 선형 확장성을 제공합니다.

- GPU 가속 준비:GPUDirect RDMA는 GPU와 네트워크 어댑터 사이의 직접 메모리 액세스를 가능하게 하며, AI 클러스터에서 CPU 병목을 제거합니다.

- 유연한 배치:단일 QSFP28 포트는 케이블링을 단순화하고 100Gb/s 잎 척추 아키텍처에 이상적입니다.

- 투자 보호:인피니밴드 및 이더넷 지원은 필요에 따라 프로토콜 간의 원활한 전환을 허용합니다.

홍콩 스타서지 그룹은 판매 전 구성 지원, 펌웨어 업데이트 지침 및 보증 서비스를 포함하여 NVIDIA ConnectX-5 어댑터에 대한 완전한 라이프사이클 지원을 제공합니다.우리 기술팀은:

- 서버 및 스위치 인프라와 호환성 검증

- HPC 또는 저장 작업 부하에 대한 성능 조정

- 맞춤형 브래킷 옵션 및 대용량 포장 요구 사항

- RMA 처리 및 고급 교체 서비스

판매 엔지니어와 연락해 대량 가격과 납품 시간 정보를 얻으세요

전기 정적 방출 (ESD):어댑터를 조작 할 때 항상 ESD 안전 방법을 사용하십시오. 설치 될 때까지 반 정적 포장에 보관하십시오.냉각 요구 사항:서버 차시에서 적절한 공기 흐름을 보장하여 정해진 범위 내에서 작동 온도를 유지합니다.펌웨어 업데이트:NVIDIA 공식 펌웨어 도구 (MFT) 를 사용 하 여 업데이트 하기 전에 OS 및 드라이버 버전과 호환성을 확인 합니다.케이블 굽기:신호 저하를 피하기 위해 QSFP28 케이블 굽기 반지름 지침을 따르십시오.

이 제품은 A급 제품입니다. 주거 환경에서 전파 간섭을 일으킬 수 있습니다.

2008년에 설립되었습니다.홍콩 스타서지 그룹 컴퍼니네트워크 하드웨어, IT 서비스 및 시스템 통합 솔루션의 기술 기반 공급 업체입니다. 네트워크 스위치, NIC, 무선 액세스 포인트,컨트롤러, 고속 케이블, 스타서지는 깊은 기술 전문 지식을 고객 우선 접근법과 결합합니다. 회사는 정부, 의료, 제조, 교육, 금융과 같은 산업을 지원합니다.,그리고 기업, IoT 솔루션, 네트워크 관리 시스템, 맞춤형 소프트웨어 개발, 그리고 다국어 글로벌 배달을 제공합니다.스타서지는 고객들이 효율적인확장 가능하고 신뢰할 수 있는 네트워크 인프라

| 부품/시스템 | 호환성 상태 | 참고문서 |

|---|---|---|

| NVIDIA 퀀텀 인피니밴드 스위치 | 인증 | 적절한 펌웨어를 사용할 때 EDR, HDR 호환성 |

| NVIDIA 스펙트럼 이더넷 스위치 | 인증 | 지원되는 100GbE, 50GbE, 25GbE 모드 |

| 제3자 100GbE 스위치 | 호환성 | IEEE 표준 준수 요구; 주요 공급 업체와 테스트 |

| GPU 서버 (NVIDIA DGX, HGX) | GPUDirect로 인증 | 멀티GPU 통신을 위한 RDMA 가속 |

| NVMe-oF를 탑재한 스토리지 배열 | 지원 | 타겟 오프로드가 효율적인 NVMe 직물 접근을 가능하게 합니다. |

- 확인 서버는 PCIe 3.0 x16 (또는 x8) 슬롯을 사용할 수 있습니다.

- 포트 수를 결정합니다: 단일 포트 (MCX555A-ECAT) 대 듀얼 포트 (MCX556A-ECAT).

- 케이블 유형을 선택하십시오: 짧은 거리 (≤5m) 를위한 수동 구리 DAC 또는 더 긴 거리를위한 광학.

- 운영 체제 및 드라이버 지원 (OFED, Windows, VMware) 을 확인합니다.

- GPU 클러스터의 경우 GPUDirect RDMA가 GPU 모델과 드라이버 버전과 호환되도록 하십시오.

- 서버 차체에 높은 또는 짧은 브래킷이 필요한지 확인하십시오.

- NVIDIA MCX556A-ECAT ∙ 듀얼 포트 100Gb/s ConnectX-5 어댑터

- NVIDIA MCX556A-EDAT PCIe 4.0 지원과 함께 ConnectX-5 Ex

- NVIDIA 퀀텀-2 QM9700 40포트 800Gb/s 인피니밴드 스위치

- 멜라노크스 QSFP28 수동 DAC 케이블 (1m, 2m, 3m)

- NVIDIA 스펙트럼-4 SN5600 100GbE/400GbE 이더넷 스위치

- NVIDIA ConnectX-5 인피니밴드 어댑터 카드 사용 설명서

- 컨버거드 이더넷 (RoCE) 구축 가이드

- GPUDirect RDMA 인공지능 클러스터에 대한 최선 사례

- 커넥트X-5를 사용하는 NVMe over Fabrics

- OFED 설치 및 조정 가이드